Nvidia Presenta Dynamo: El Nuevo Servidor de Inferencia de IA de Código Abierto

En la conferencia GTC 2025, Nvidia presentó Dynamo, un nuevo servidor de inferencia de IA de código abierto diseñado para atender a la última generación de grandes modelos de IA a escala. Dynamo es el sucesor del ampliamente utilizado Triton Inference Server de Nvidia y representa un avance estratégico en la pila de IA de la compañía. Está construido para orquestar la inferencia de modelos de IA a través de flotas masivas de GPU con alta eficiencia, permitiendo que lo que Nvidia llama «fábricas de IA» generen conocimientos y respuestas más rápido y a un menor costo.

Este artículo proporciona una visión técnica de la arquitectura, características y el valor que Dynamo ofrece a las empresas.

Componente Clave de la Estrategia de «Fábrica de IA» de Nvidia

En su núcleo, Dynamo es un marco de inferencia de alto rendimiento y baja latencia para desplegar modelos de IA generativa y de razonamiento en entornos distribuidos. Se integra en la plataforma de IA de pila completa de Nvidia como el sistema operativo de las «fábricas de IA», conectando GPUs avanzadas, redes y software para mejorar el rendimiento de la inferencia.

El CEO de Nvidia, Jensen Huang, enfatizó la importancia de Dynamo comparándolo con las dínamos de la Revolución Industrial, un catalizador que convierte una forma de energía en otra, excepto que aquí, convierte la potencia bruta de la GPU en valiosas salidas de modelos de IA a una escala sin precedentes.

Dynamo se alinea con la estrategia de Nvidia de proporcionar una infraestructura de IA de extremo a extremo. Ha sido construido para complementar la nueva arquitectura de GPU Blackwell de Nvidia y las soluciones de centros de datos de IA. Por ejemplo, los sistemas Blackwell Ultra proporcionan la inmensa capacidad de cómputo y memoria para el razonamiento de IA, mientras que Dynamo proporciona la inteligencia para utilizar esos recursos de manera eficiente.

Dynamo es totalmente de código abierto, continuando el enfoque abierto de Nvidia hacia el software de IA. Soporta marcos de IA populares y motores de inferencia, incluyendo PyTorch, SGLang, TensorRT-LLM de Nvidia y vLLM. Esta amplia compatibilidad significa que las empresas y startups pueden adoptar Dynamo sin reconstruir sus modelos desde cero. Se integra perfectamente con los flujos de trabajo de IA existentes. Los principales proveedores de nube y tecnología como AWS, Google Cloud, Microsoft Azure, Dell, Meta y otros ya están planeando integrar o soportar Dynamo, lo que subraya su importancia estratégica en toda la industria.

Características del Motor de Inferencia Dynamo

Dynamo está diseñado desde cero para servir a los últimos modelos de razonamiento, como DeepSeek R1. Servir grandes LLMs y modelos de razonamiento altamente capaces de manera eficiente requiere nuevos enfoques más allá de lo que proporcionaban los servidores de inferencia anteriores.

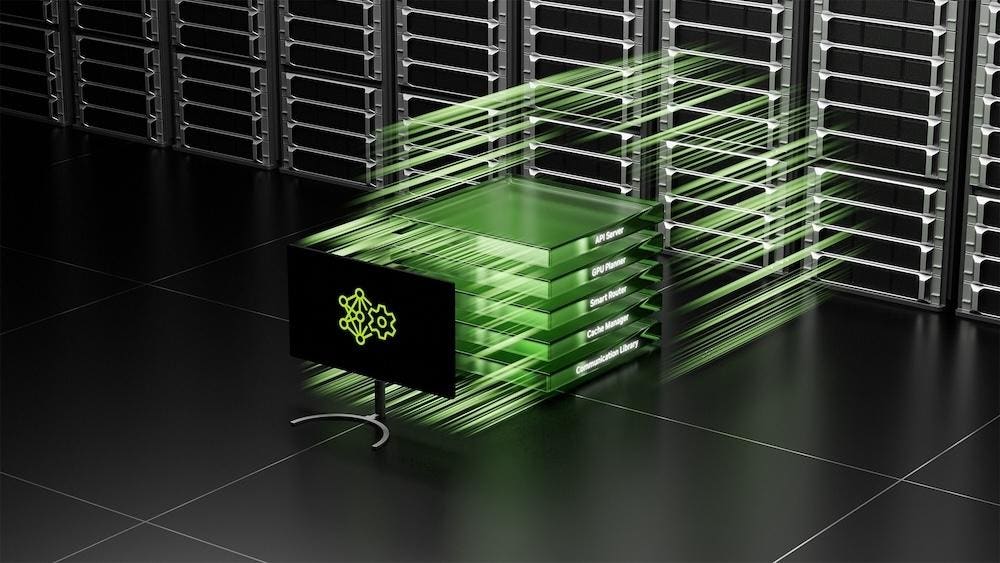

Dynamo introduce varias innovaciones clave en su arquitectura para satisfacer estas necesidades:

- Planificador Dinámico de GPU: Agrega o elimina dinámicamente trabajadores de GPU en función de la demanda en tiempo real, evitando el aprovisionamiento excesivo o la infrautilización del hardware. En la práctica, esto significa que si las solicitudes de los usuarios aumentan, Dynamo puede asignar temporalmente más GPUs para manejar la carga, y luego reducirla, optimizando la utilización y el costo.

- Enrutador Inteligente Consciente de LLM: Enruta inteligentemente las solicitudes de IA entrantes a través de un gran clúster de GPU para evitar cálculos redundantes. Realiza un seguimiento de lo que cada GPU tiene en su caché de conocimiento (la parte de la memoria que almacena el contexto reciente del modelo) y envía cada consulta al nodo de GPU mejor preparado para manejarla. Este enrutamiento consciente del contexto evita volver a pensar repetidamente el mismo contenido y libera capacidad para nuevas solicitudes.

- Biblioteca de Comunicación de Baja Latencia (NIXL): Proporciona una transferencia de datos y mensajería acelerada de GPU a GPU de última generación, abstrayendo la complejidad de mover datos a través de miles de nodos. Al reducir la sobrecarga de comunicación y la latencia, esta capa asegura que la división del trabajo entre muchas GPUs no se convierta en un cuello de botella. Funciona a través de diferentes interconexiones y configuraciones de red, por lo que las empresas pueden beneficiarse tanto si utilizan NVLink ultrarrápido, InfiniBand o clústeres Ethernet.

- Administrador de Memoria Distribuida (KV): Descarga y recarga datos de inferencia (particularmente datos de caché de «claves y valores» de la generación de tokens anterior) a niveles de memoria o almacenamiento de menor costo cuando sea apropiado. Esto significa que los datos menos críticos pueden residir en la memoria del sistema o incluso en el disco, reduciendo el uso costoso de la memoria de la GPU, pero se pueden recuperar rápidamente cuando sea necesario. El resultado es un mayor rendimiento y un menor costo sin afectar la experiencia del usuario.

- Servicio Desagregado: El servicio tradicional de LLM realizaría todos los pasos de inferencia (desde el procesamiento del prompt hasta la generación de la respuesta) en la misma GPU o nodo, lo que a menudo infrautilizaba los recursos. Dynamo, en cambio, divide estas etapas en una etapa de prellenado que interpreta la entrada y una etapa de decodificación que produce los tokens de salida, que pueden ejecutarse en diferentes conjuntos de GPUs.

Mirando hacia el Futuro

A medida que los modelos de razonamiento de IA se vuelven más comunes, Dynamo representa una capa de infraestructura crítica para las empresas que buscan desplegar estas capacidades de manera eficiente. Dynamo revoluciona la economía de la inferencia al mejorar la velocidad, la escalabilidad y la asequibilidad, permitiendo a las organizaciones proporcionar experiencias de IA avanzadas sin un aumento proporcional en los costos de infraestructura.

Para los CXOs que priorizan las iniciativas de IA, Dynamo ofrece un camino hacia eficiencias operativas inmediatas y ventajas estratégicas a largo plazo en un panorama competitivo cada vez más impulsado por la IA.

Insights de Evox News: Cómo Dynamo Puede Impactar tu Negocio

La introducción de Dynamo por parte de Nvidia tiene el potencial de impactar significativamente a las empresas en varias áreas clave:

- Reducción de Costos: La optimización del uso de GPU a través del Planificador Dinámico y el Administrador de Memoria Distribuida permite a las empresas reducir significativamente los costos de infraestructura de IA. Al utilizar los recursos de manera más eficiente, las empresas pueden lograr el mismo o mejor rendimiento con menos hardware.

- Escalabilidad Mejorada: La arquitectura de Dynamo permite a las empresas escalar sus capacidades de IA de manera más flexible y eficiente. El Enrutador Inteligente y la Biblioteca de Comunicación de Baja Latencia facilitan la distribución de la carga de trabajo entre múltiples GPUs, lo que permite a las empresas manejar picos de demanda sin problemas.

- Ventaja Competitiva a través de la Innovación: Al permitir el despliegue eficiente de modelos de razonamiento de IA avanzados, Dynamo permite a las empresas ofrecer experiencias de usuario mejoradas y desarrollar nuevos productos y servicios basados en IA. Esto puede traducirse en una ventaja competitiva significativa en el mercado.

- Aceleración del Tiempo de Comercialización: La compatibilidad de Dynamo con los marcos de IA y motores de inferencia existentes, junto con su naturaleza de código abierto, reduce las barreras de entrada para la adopción de tecnologías de IA avanzadas. Esto permite a las empresas acelerar el tiempo de comercialización de nuevas soluciones basadas en IA.

- Optimización de la Infraestructura: Dynamo ayuda a las empresas a optimizar su infraestructura de IA, haciendo un uso más eficiente de los recursos existentes y reduciendo la necesidad de inversiones costosas en hardware adicional. El servicio desagregado permite utilizar los recursos de GPU de forma óptima.

En resumen, Dynamo representa una oportunidad para que las empresas de todos los tamaños optimicen sus operaciones de IA, reduzcan costos, mejoren la escalabilidad y obtengan una ventaja competitiva a través de la innovación. Las empresas que adopten esta tecnología estarán mejor posicionadas para capitalizar el creciente potencial de la IA en el futuro.